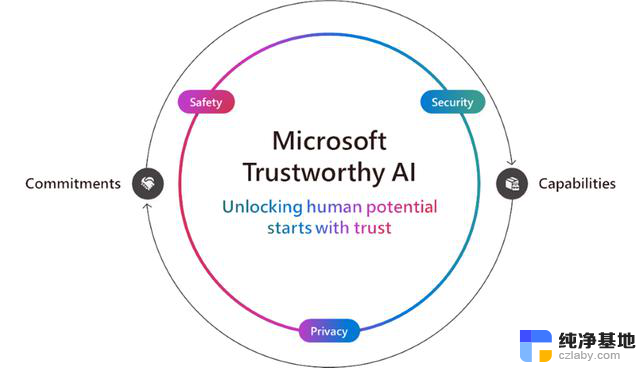

可信的微软人工智能:从信任开始释放人类潜能,人工智能信任的重要性

在微软,我们致力于打造可信的人工智能(Trustworthy AI),并提供领先业界的支持技术。我们的承诺与能力并驾齐驱,全方位地守护客户和开发者。

在这一承诺的基础上,微软于今日宣布全新的产品功能,以加强AI系统的保障、安全及私隐。

安全性(Security)。在微软,我们一直将安全置于首位,而随之延伸出的“安全未来计划”(Secure Future Initiative, SFI)也强调了微软对保障客户安全的承诺和责任。本周,我们发布了首份 SFI 进展报告,重点介绍这一计划在企业文化、治理、技术和营运方面的最新进展。这也印证了微软“安全至上”的承诺,并以“安全设计”、“安全默认”和“安全运营”三原则为指导。除了第一方的Microsoft Defender 和 Purview 以外,微软的 AI 服务还具备0基本的安全控制,例如防止指令注入 (prompt injections)及侵犯版权的内置功能。在此基础上,我们今日将宣布国际版云服务的两项全新功能:

我们的安全功能已被客户广泛应用。拥有 105 年历史的康明斯(Cummins),以引擎制造及清洁能源技术开发而闻名。该公司选择了 Microsoft Purview ,通过自动化数据分类、标签和标注,加强其数据安全和治理。而软件工程及商业顾问公司EPAM Systems 则为其300名用户部署了智能 Microsoft 365 Copilot副驾驶®,以获得由微软提供的数据保护功能。IT 高级总监 J.T. Sodano 表示:“我们在Microsoft Purview 中配置的信息和数据保护政策同样适用于智能 Copilot副驾驶®,因此与其他大型语言模型(LLMs)相比。我们对智能 Copilot副驾驶® for Microsoft 365更有信心。”

保障性(Safety)。2018 年,微软发布了更广泛的负责任 AI 原则,涵盖安全和私隐两大要素,这一原则也持续指引我们在全公司构建和部署 AI。在实践中,这意味着正确地建立、测试和监测系统,以避免不良行为,例如有害内容、偏见、滥用和其他意外风险等。多年来,微软在建立必要的治理架构、政策、工具和流程方面进行了大量投入,藉此维护这些原则,并安全地构建和部署 AI。微软致力于与客户分享我们在遵循负责任 AI 原则的过程中获得经验。利用自身的最佳实践与经验,微软为个人和企业提供所需的功能及工具,帮助其打造与微软自身追求一致的高标准AI应用。

今日,我们还带来几个帮助客户追求在AI效益的同时降低风险的国际版云服务的全新功能:

我们很高兴地见到,不同行业的客户均已开始采用微软的解决方案建立更安全和可信的AI 应用。例如,3D游戏平台Unity 运用 Microsoft Azure OpenAI Service建构AI 助手Muse Chat,通过Azure AI Content Safety中的内容过滤模型确保负责任的软件应用,令游戏开发过程更轻松。坐拥近900个品牌合作伙伴的英国时尚零售商ASOS同样利用Azure AI Content Safety的内置内容过滤器,通过 AI 应用支持高质互动,帮助客户发掘新造型。

我们也在教育领域见证了同样的影响。纽约市公立学校(New York City Public Schools)与微软合作打造了一个安全且适合教育情景的聊天系统,目前正在学校进行试点。南澳大利亚教育部(The South Australia Department for Education)同样通过 EdChat 将生成式AI引入课堂,依靠相同的基础架构确保学生与老师都能够安全使用。

私隐(Privacy)。数据是 AI 的基础。微软的首要任务就是基于我们长期以来的私隐原则确保客户数据受到保护且合规。这些原则包括用户控制、透明度以及法律和监管保护。基于这一点,我们今天宣布:

我们见证了客户对机密计算和机密 GPUs兴趣的与日俱增。其中包括应用安全供货商 F5 ,他们正在使用搭载NVIDIA H100 Tensor Core GPUs 的 Azure Confidential VMs(国际版)建构先进的 AI 驱动安全解决方案,并确保其模型正在分析的数据机密性。另外,跨国银行企业加拿大皇家银行(RBC)已将 Azure 机密计算(国际版)融入其平台,在保护客户私隐的同时分析加密数据。随着搭载NVIDIA H100 Tensor Core GPUs 的 Azure Confidential VMs(国际版)正式商用,加拿大皇家银行现在可以利用这些先进的AI工具提高工作效率,开发更强大的AI模型。

我们都需要和期待可信的 AI ,而我们见证当人们被赋能以可信任方式使用 AI时,从丰富员工经验和重塑业务流程,到重新定义客户互动,以至重新想象我们的日常生活,一切皆变得可能。随着提高保障、安全和私隐的新功能推出,我们将继续帮助客户使用和构建可信的AI解决方案,以予力全球每一人、每一组织,成就不凡。归根结底,可信的AI 涵盖了我们在微软所做的一切,这对我们的使命来说至关重要,我们会继续致力于拓展机遇、赢得信任、保护基本权利,并在我们所做的每一件事中推进可持续发展。

--结束--

关于微软

微软(纳斯达克代码“MSFT” @microsoft)以人工智能赋能创新的解决方案平台和工具,来满足客户不断发展的需求。作为一家技术公司,微软致力于负责任地推广人工智能,以予力全球每一人、每一组织,成就不凡。

可信的微软人工智能:从信任开始释放人类潜能,人工智能信任的重要性相关教程

-

微软和谷歌高管访问印度推广人工智能应用,加速印度人工智能应用发展

微软和谷歌高管访问印度推广人工智能应用,加速印度人工智能应用发展2024-02-01

-

微软推出Copilot Pro,个人用户仅需20美元即可享受先进的人工智能功能

微软推出Copilot Pro,个人用户仅需20美元即可享受先进的人工智能功能2024-01-16

-

微软宣布新增人工智能按键,为“AI PC之年”开幕

微软宣布新增人工智能按键,为“AI PC之年”开幕2024-01-04

-

微软的AI策略:软硬结合,多交朋友,引领人工智能发展

微软的AI策略:软硬结合,多交朋友,引领人工智能发展2023-11-17

- 微软开始销售面向消费者的人工智能助理Copilot,提升工作效率的最佳选择

- NVIDIA在人工智能繁荣中不断培育着新一批百万富翁,推动人工智能产业蓬勃发展

- 微软成立新人工智能团队,专注于小型模型开发

- 微软人工智能副总裁Sébastien Bubeck将离职并加入OpenAI,开启新篇章

- OpenAI前CEO将加入微软,引领人工智能巨头联手迎接新挑战

- Microsoft Research Forum首期上线:探索通用型人工智能的前沿研究

- 微软发力!暴雪首次为其他游戏打广告,大秘境难度再次下调

- 亚马逊畅销排行榜:AMD一统江湖,全球最热门的10款CPU推荐!

- 电脑的CPU 都有哪些品牌,你知道几个? - 了解电脑CPU的常见品牌

- 如何正确更新NVIDIA显卡驱动以提升性能和稳定性:详细教程

- 微软游戏业务负责人:未来还会继续推出Xbox游戏机,打造更多优秀游戏体验

- 微软GraphRAG AI提效:改善数据检索,tokens成本降低77%的全面指南

微软资讯推荐

- 1 微软发力!暴雪首次为其他游戏打广告,大秘境难度再次下调

- 2 电脑的CPU 都有哪些品牌,你知道几个? - 了解电脑CPU的常见品牌

- 3 如何正确更新NVIDIA显卡驱动以提升性能和稳定性:详细教程

- 4 微软游戏业务负责人:未来还会继续推出Xbox游戏机,打造更多优秀游戏体验

- 5 微软GraphRAG AI提效:改善数据检索,tokens成本降低77%的全面指南

- 6 英伟达AI大模型被曝不及预期,国产GPU能否平替?

- 7 如何查看电脑的显卡型号和性能信息?快速了解电脑显卡配置方法

- 8 微软推送Win10服务器端更新,Win11 24H2升级推荐速度快

- 9 如何正确更新NVIDIA显卡驱动以提升性能和稳定性?

- 10 台式电脑CPU天梯图2024年11月新版 桌面CPU性能排行榜:最新CPU性能排名

win10系统推荐

系统教程推荐